Презентация на тему: Вопросы программирования и оптимизации приложений на CUDA

Лекторы: Лекторы: Обухов А.Н. (Nvidia) Боресков А.В. (ВМиК МГУ) Харламов А.А. (Nvidia)

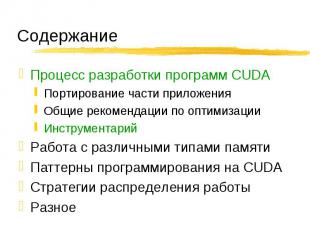

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Стратегии распределения работы Разное

Процесс разработки программ CUDA Процесс разработки программ CUDA Портирование части приложения Общие рекомендации по оптимизации Инструментарий Работа с различными типами памяти Паттерны программирования на CUDA Стратегии распределения работы Разное

Определение класса портируемой задачи Определение класса портируемой задачи Уровень параллелизма. SIMD Классы задач, которые в общем случае невозможно распараллелить

Процесс разработки программ CUDA Процесс разработки программ CUDA Портирование части приложения Общие рекомендации по оптимизации Инструментарий Работа с различными типами памяти Паттерны программирования на CUDA Стратегии распределения работы Разное

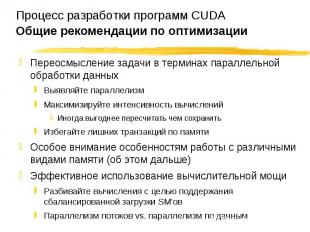

Переосмысление задачи в терминах параллельной обработки данных Переосмысление задачи в терминах параллельной обработки данных Выявляйте параллелизм Максимизируйте интенсивность вычислений Иногда выгоднее пересчитать чем сохранить Избегайте лишних транзакций по памяти Особое внимание особенностям работы с различными видами памяти (об этом дальше) Эффективное использование вычислительной мощи Разбивайте вычисления с целью поддержания сбалансированной загрузки SM’ов Параллелизм потоков vs. параллелизм по данным

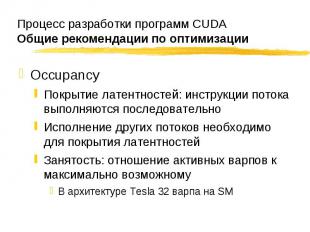

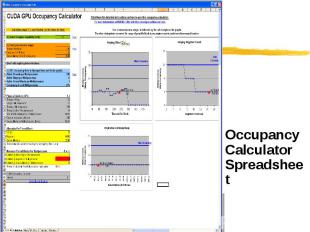

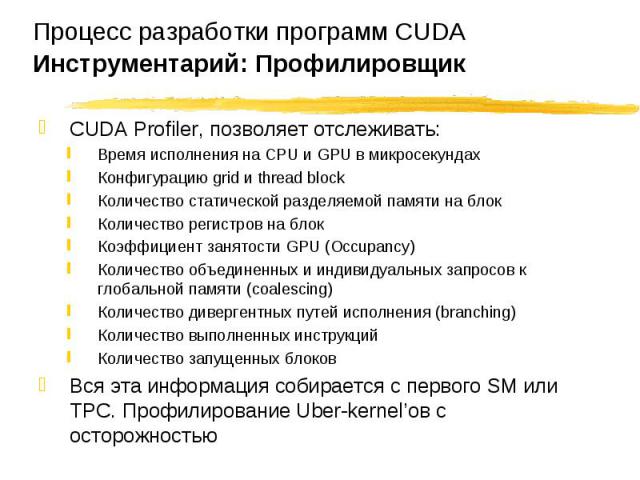

Occupancy Occupancy Покрытие латентностей: инструкции потока выполняются последовательно Исполнение других потоков необходимо для покрытия латентностей Занятость: отношение активных варпов к максимально возможному В архитектуре Tesla 32 варпа на SM

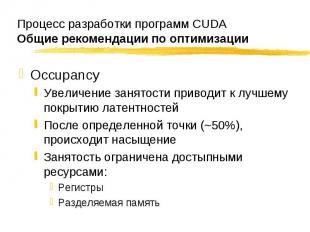

Occupancy Occupancy Увеличение занятости приводит к лучшему покрытию латентностей После определенной точки (~50%), происходит насыщение Занятость ограничена достыпными ресурсами: Регистры Разделяемая память

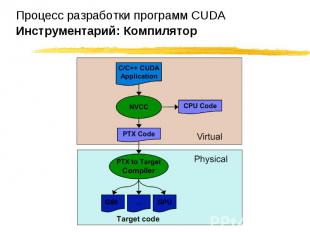

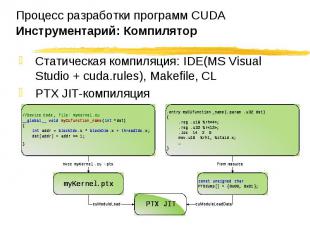

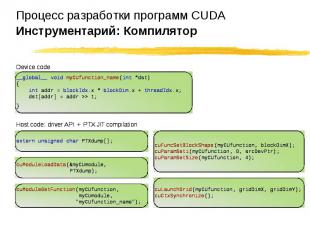

Процесс разработки программ CUDA Процесс разработки программ CUDA Портирование части приложения Общие рекомендации по оптимизации Инструментарий Работа с различными типами памяти Паттерны программирования на CUDA Стратегии распределения работы Разное

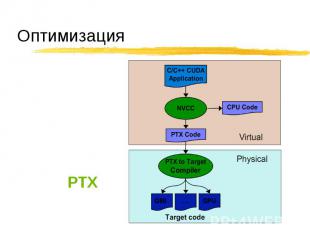

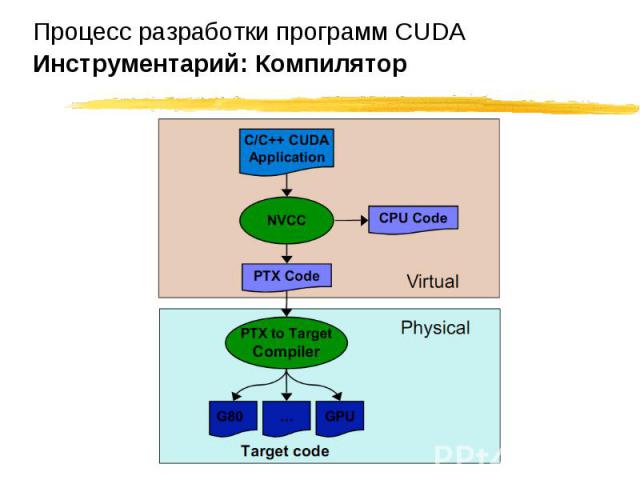

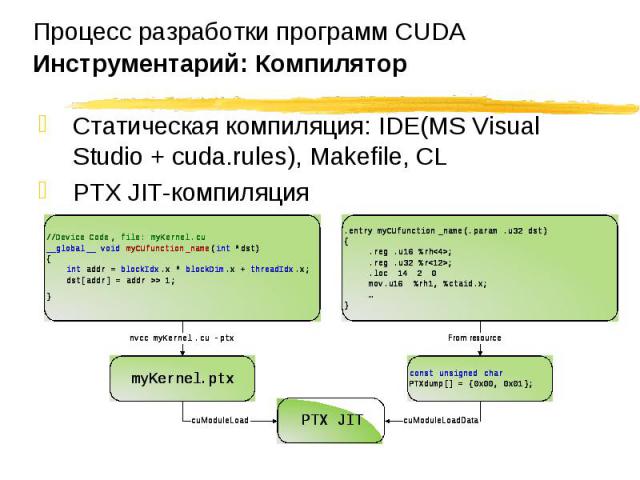

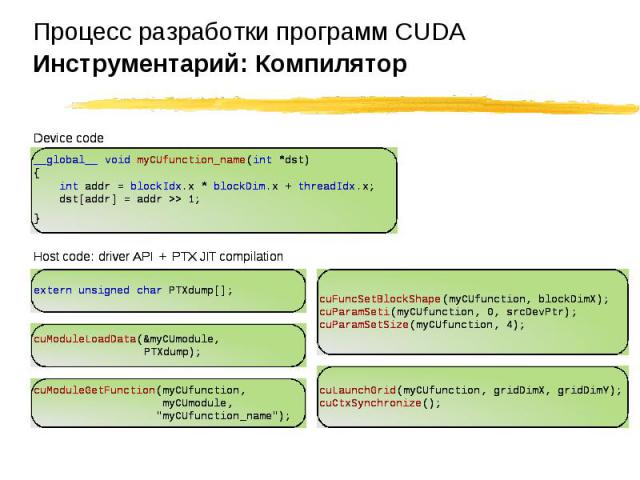

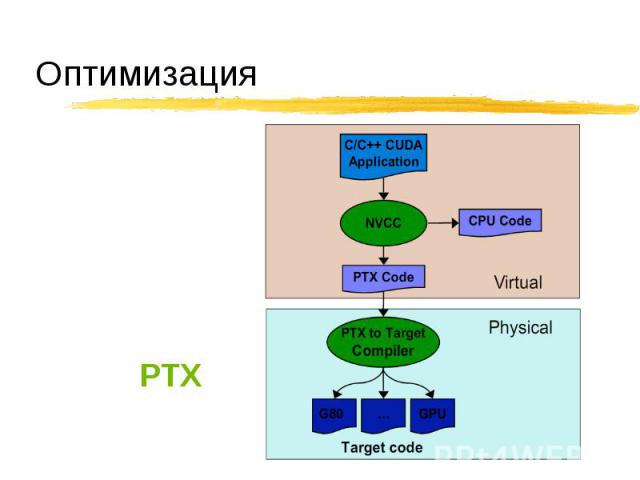

Статическая компиляция: IDE(MS Visual Studio + cuda.rules), Makefile, CL Статическая компиляция: IDE(MS Visual Studio + cuda.rules), Makefile, CL PTX JIT-компиляция

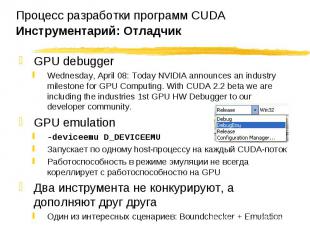

GPU debugger GPU debugger Wednesday, April 08: Today NVIDIA announces an industry milestone for GPU Computing. With CUDA 2.2 beta we are including the industries 1st GPU HW Debugger to our developer community. GPU emulation -deviceemu D_DEVICEEMU Запускает по одному host-процессу на каждый CUDA-поток Работоспособность в режиме эмуляции не всегда кореллирует с работоспособностю на GPU Два инструмента не конкурируют, а дополняют друг друга Один из интересных сценариев: Boundchecker + Emulation

Достоинства эмуляции Достоинства эмуляции Исполняемый файл, скомпилированный в режиме эмуляции работает целиком на CPU Не требуется драйвер CUDA и GPU Каждый поток GPU эмулируется потоком CPU При работе в режиме эмуляции можно: Использовать средства отладки CPU (точки останова и т.д.) Обращаться к любым данным GPU с CPU и наоборот Делать любые CPU-вызовы из код GPU и наоборот (например printf()) Выявлять ситуации зависания, возникающие из-за неправильного применения __syncthreads()

Недостатки эмуляции Недостатки эмуляции Часто работает очень медленно Неумышленное разыменование указателей GPU на стороне CPU или наоборот Результаты операций с плавающей точкой CPU и «настоящего» GPU почти всегда различаются из-за: Разного порядка выполняемых операций Разных допустимых ошибок результатов Использования большей точности при расчёте промежуточных результатов на CPU

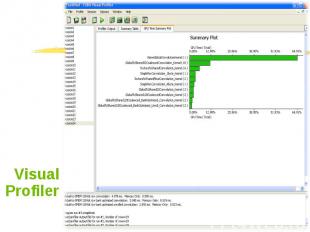

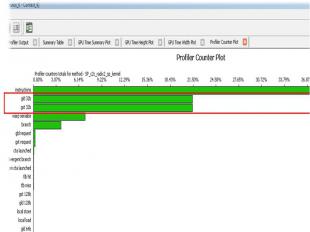

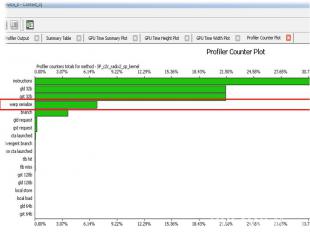

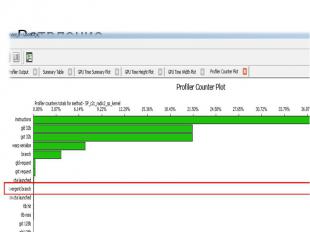

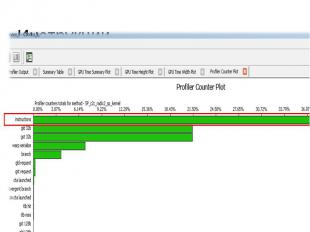

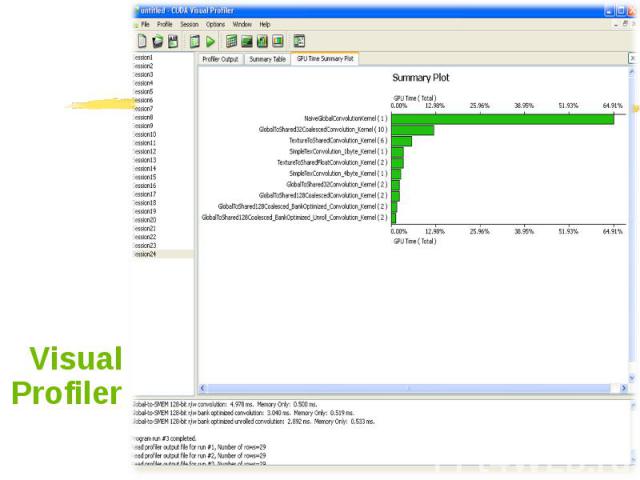

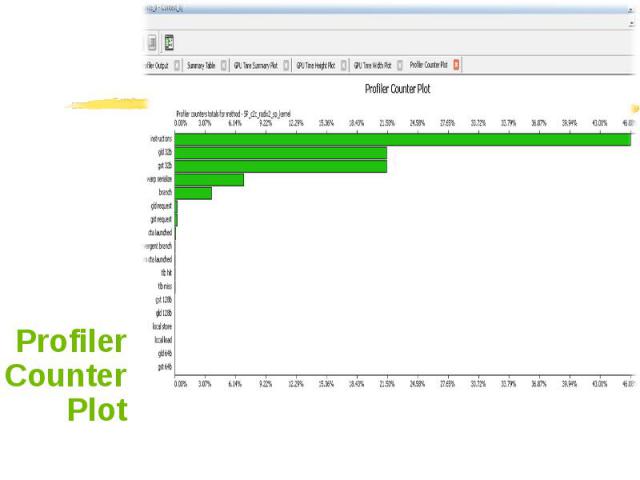

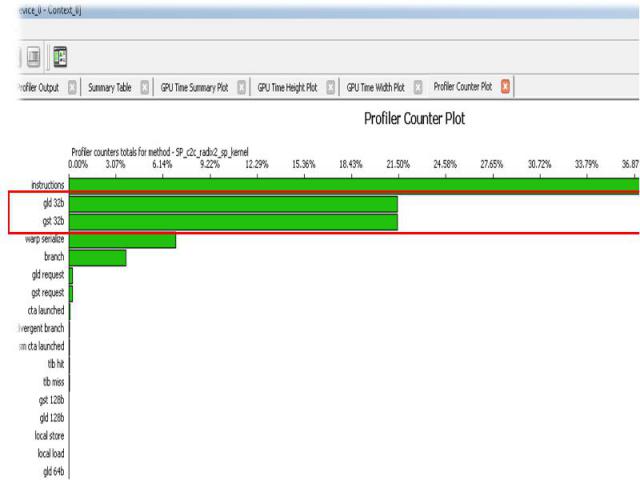

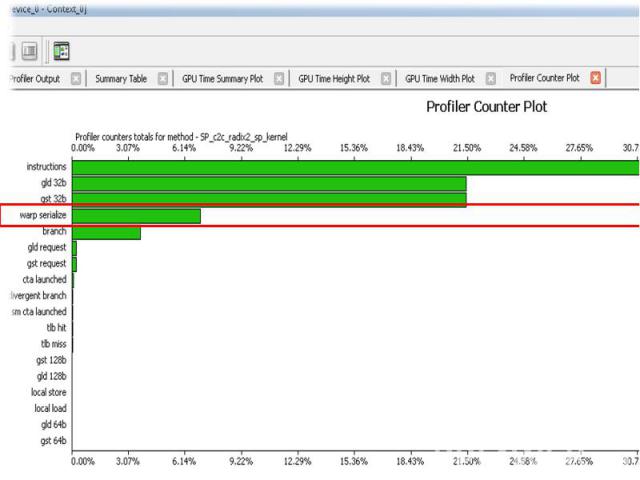

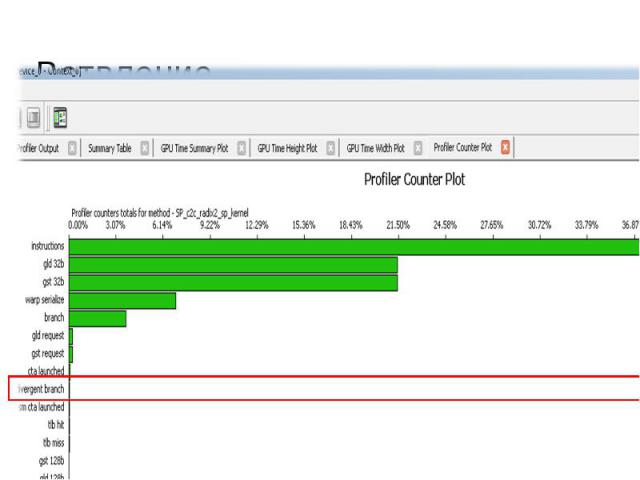

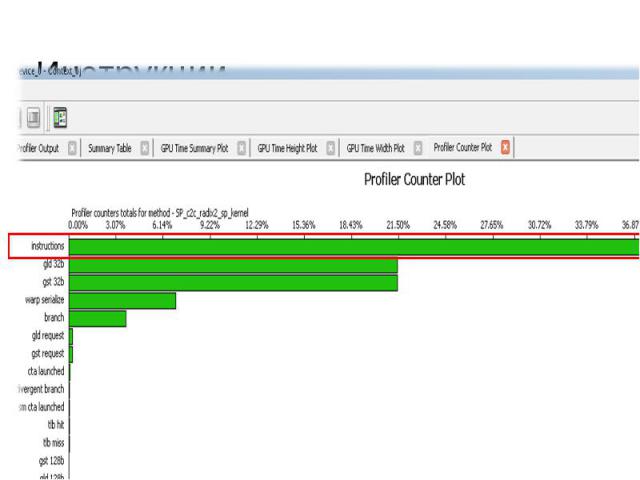

CUDA Profiler, позволяет отслеживать: CUDA Profiler, позволяет отслеживать: Время исполнения на CPU и GPU в микросекундах Конфигурацию grid и thread block Количество статической разделяемой памяти на блок Количество регистров на блок Коэффициент занятости GPU (Occupancy) Количество объединенных и индивидуальных запросов к глобальной памяти (coalescing) Количество дивергентных путей исполнения (branching) Количество выполненных инструкций Количество запущенных блоков Вся эта информация собирается с первого SM или TPC. Профилирование Uber-kernel’ов с осторожностью

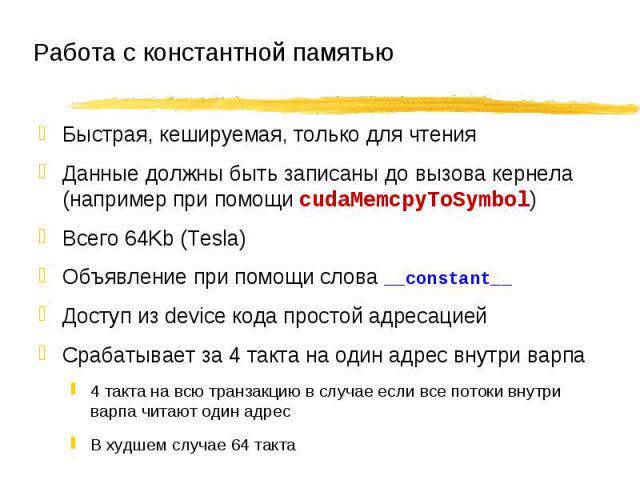

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Константная Текстурная Глобальная Разделяемая Паттерны программирования на CUDA Стратегии распределения работы Разное

Быстрая, кешируемая, только для чтения Быстрая, кешируемая, только для чтения Данные должны быть записаны до вызова кернела (например при помощи cudaMemcpyToSymbol) Всего 64Kb (Tesla) Объявление при помощи слова __constant__ Доступ из device кода простой адресацией Срабатывает за 4 такта на один адрес внутри варпа 4 такта на всю транзакцию в случае если все потоки внутри варпа читают один адрес В худшем случае 64 такта

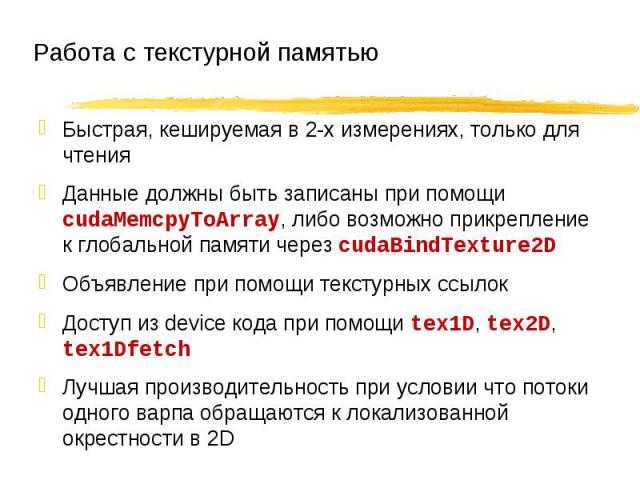

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Константная Текстурная Глобальная Разделяемая Паттерны программирования на CUDA Стратегии распределения работы Разное

Быстрая, кешируемая в 2-х измерениях, только для чтения Быстрая, кешируемая в 2-х измерениях, только для чтения Данные должны быть записаны при помощи cudaMemcpyToArray, либо возможно прикрепление к глобальной памяти через cudaBindTexture2D Объявление при помощи текстурных ссылок Доступ из device кода при помощи tex1D, tex2D, tex1Dfetch Лучшая производительность при условии что потоки одного варпа обращаются к локализованной окрестности в 2D

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Константная Текстурная Глобальная Разделяемая Паттерны программирования на CUDA Стратегии распределения работы Разное

Медленная, некешируемая (G80), чтение/запись Медленная, некешируемая (G80), чтение/запись Запись данных с/на хост через cudaMemcpy* Транзакции по PCI-e медленные: макс. 4GB/s vs. 80 GB/s при копировании device-device Возможность асинхронных транзакций Ускорение транзакций путем выделения host page-locked памяти (cudaMallocHost) Объявление при помощи слова __global__ Доступ простой индексацией Время доступа от 400 до 600 тактов на транзакцию – высокая латентность

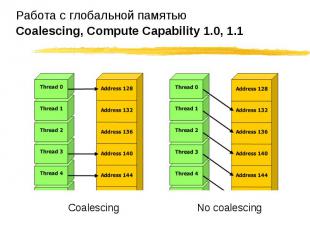

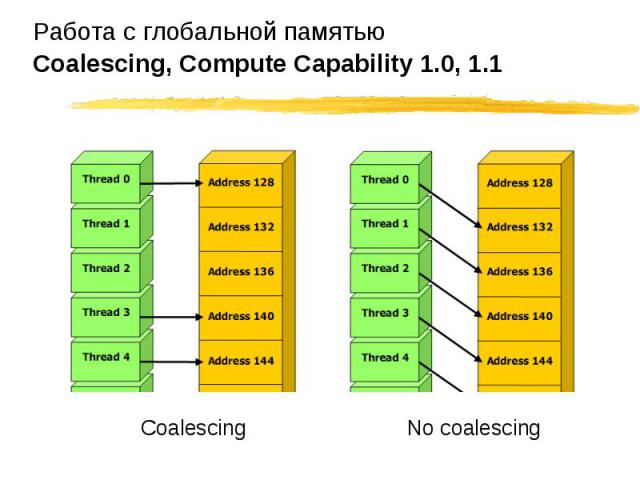

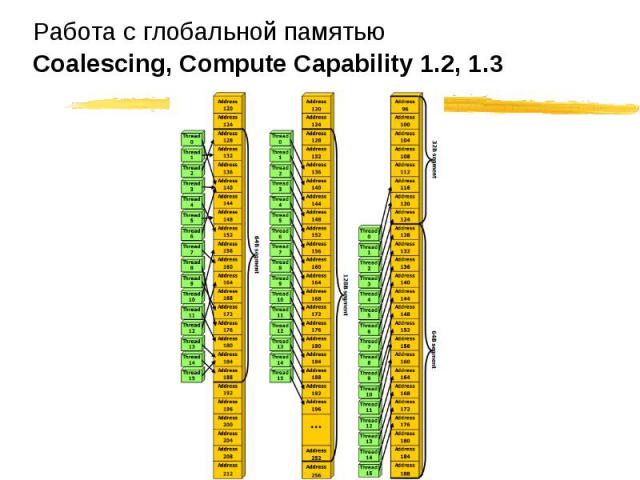

16 потоков. Типы транзакций: 16 потоков. Типы транзакций: 4-байтовые слова, одна 64-байтовая транзакция 8-байтовые слова, одна 128-байтовая транзакция 16-байтовые слова, две 128-байтовых транзакции Все 16 элементов должны лежать в едином сегменте, размер и выравнивание которого совпадает с размером транзакции Строгий порядок доступа: k-й поток обращается к k-му элементу в сегменте При нарушении порядка вместо одной транзакции получается 16 Некоторые из потоков могут не участвовать

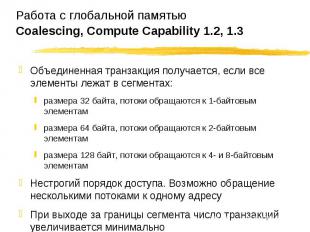

Объединенная транзакция получается, если все элементы лежат в сегментах: Объединенная транзакция получается, если все элементы лежат в сегментах: размера 32 байта, потоки обращаются к 1-байтовым элементам размера 64 байта, потоки обращаются к 2-байтовым элементам размера 128 байт, потоки обращаются к 4- и 8-байтовым элементам Нестрогий порядок доступа. Возможно обращение несколькими потоками к одному адресу При выходе за границы сегмента число транзакций увеличивается минимально

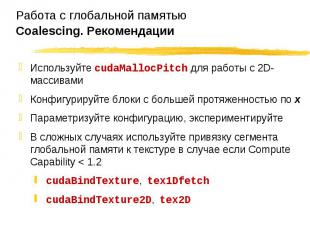

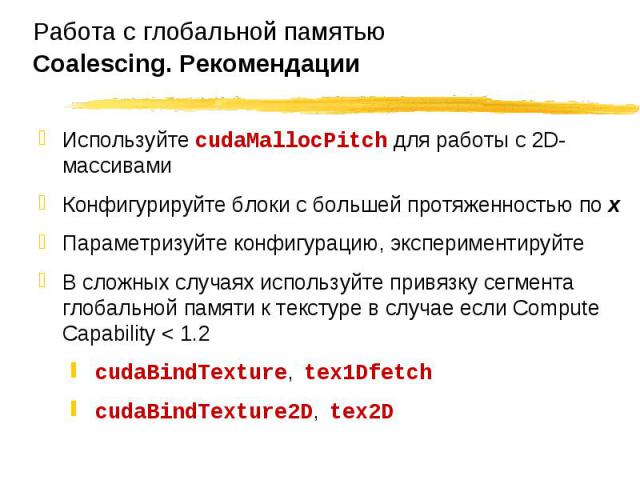

Используйте cudaMallocPitch для работы с 2D-массивами Используйте cudaMallocPitch для работы с 2D-массивами Конфигурируйте блоки с большей протяженностью по x Параметризуйте конфигурацию, экспериментируйте В сложных случаях используйте привязку сегмента глобальной памяти к текстуре в случае если Compute Capability < 1.2 cudaBindTexture, tex1Dfetch cudaBindTexture2D, tex2D

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Константная Текстурная Глобальная Разделяемая Паттерны программирования на CUDA Стратегии распределения работы Разное

Быстрая, некешируемая, чтение/запись Быстрая, некешируемая, чтение/запись Объявление при помощи слова __shared__ Доступ из device кода при помощи индексирования Самый быстрый тип памяти после регистров, низкая латентность доступа Можно рассматривать как полностью открытый L1-кеш При работе с разделяемой памятью следует помнить о ее разбиении на банками памяти

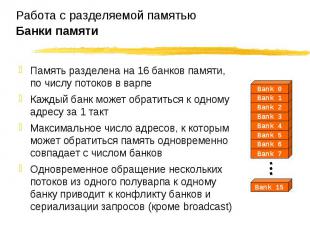

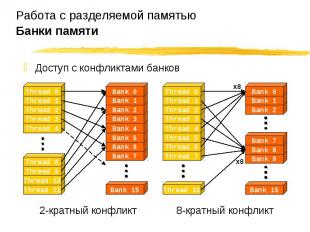

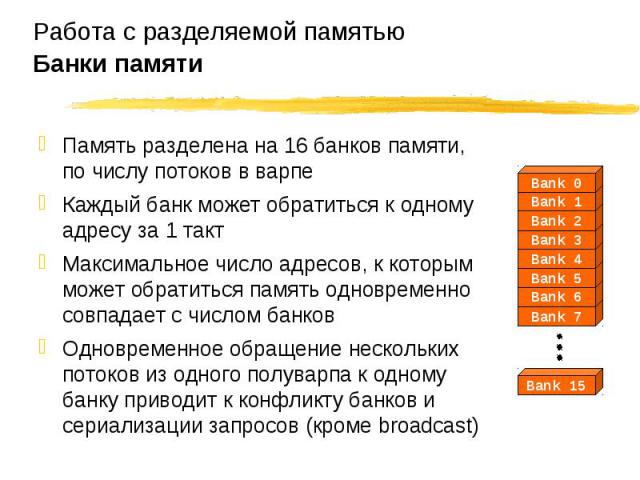

Память разделена на 16 банков памяти, по числу потоков в варпе Память разделена на 16 банков памяти, по числу потоков в варпе Каждый банк может обратиться к одному адресу за 1 такт Максимальное число адресов, к которым может обратиться память одновременно совпадает с числом банков Одновременное обращение нескольких потоков из одного полуварпа к одному банку приводит к конфликту банков и сериализации запросов (кроме broadcast)

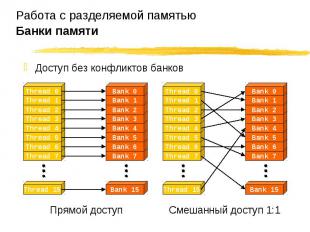

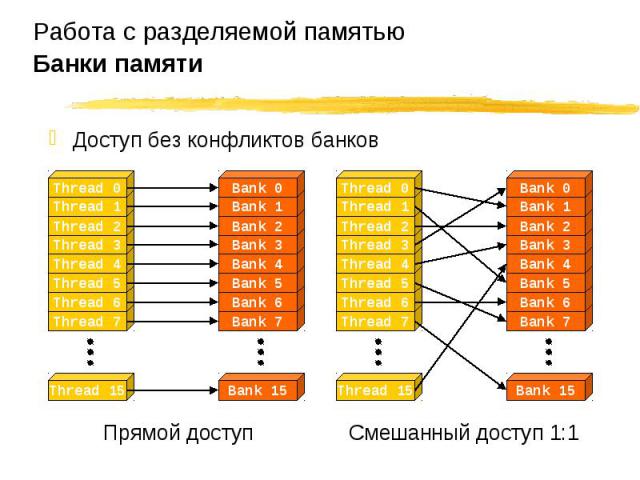

Доступ без конфликтов банков Доступ без конфликтов банков

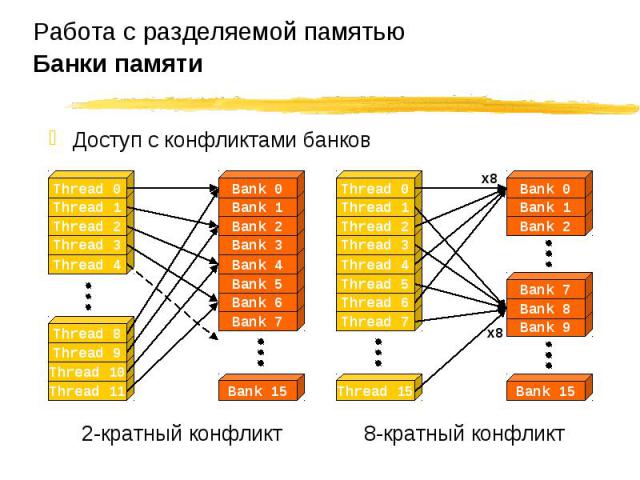

Доступ с конфликтами банков Доступ с конфликтами банков

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Приоритеты оптимизации Сценарий работы с shared памятью Копирование global <-> shared Обработка в shared памяти Стратегии распределения работы Разное

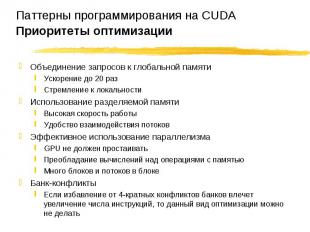

Объединение запросов к глобальной памяти Объединение запросов к глобальной памяти Ускорение до 20 раз Стремление к локальности Использование разделяемой памяти Высокая скорость работы Удобство взаимодействия потоков Эффективное использование параллелизма GPU не должен простаивать Преобладание вычислений над операциями с памятью Много блоков и потоков в блоке Банк-конфликты Если избавление от 4-кратных конфликтов банков влечет увеличение числа инструкций, то данный вид оптимизации можно не делать

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Приоритеты оптимизации Сценарий работы с shared памятью Копирование global <-> shared Обработка в shared памяти Стратегии распределения работы Разное

Загрузка данных из глобальной памяти в разделяемой Загрузка данных из глобальной памяти в разделяемой __syncthreads(); Обработка данных в разделяемой памяти __syncthreads(); //если требуется Сохранение результатов в глобальной памяти Шаги 2–4 могут быть обрамлены в условия и циклы Шаг 4 может быть ненужен в случае если выходные данные независимы между собой

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Приоритеты оптимизации Сценарий работы с shared памятью Копирование global <-> shared Обработка в shared памяти Стратегии распределения работы Разное

![dim3 block(64); dim3 block(64); __shared__ float dst[64]; __global__ void kernel dim3 block(64); dim3 block(64); __shared__ float dst[64]; __global__ void kernel](https://fs1.ppt4web.ru/images/95232/150388/310/img43.jpg)

dim3 block(64); dim3 block(64); __shared__ float dst[64]; __global__ void kernel(float *data) {//coalescing, no bank conflicts dst[threadIdx.x] = data[threadIdx.x]; }

![dim3 block(64); dim3 block(64); __shared__ byte dst[64]; __global__ void kernel_ dim3 block(64); dim3 block(64); __shared__ byte dst[64]; __global__ void kernel_](https://fs1.ppt4web.ru/images/95232/150388/310/img44.jpg)

dim3 block(64); dim3 block(64); __shared__ byte dst[64]; __global__ void kernel_bad(byte *data) {//no coalescing, 4-way bank conflicts present dst[threadIdx.x] = data[threadIdx.x]; } __global__ void kernel_good(byte *data) {//coalescing, no bank conflicts, no branching if (threadIdx.x < 16) { int tx = threadIdx.x * 4; *((int *)(dst + tx)) = *((int *)(data + tx)); } }

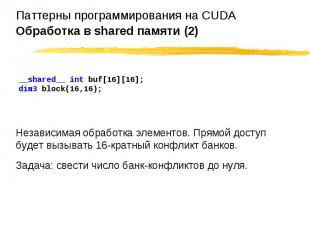

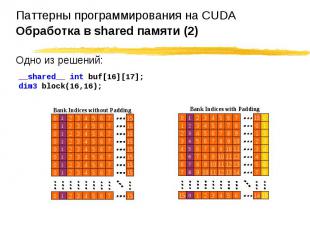

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Приоритеты оптимизации Сценарий работы с shared памятью Копирование global <-> shared Обработка в shared памяти Стратегии распределения работы Разное

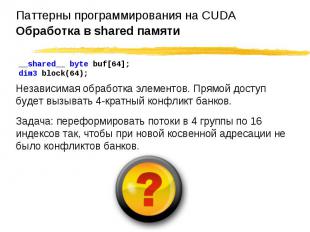

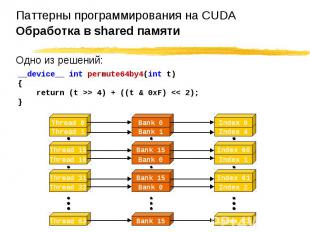

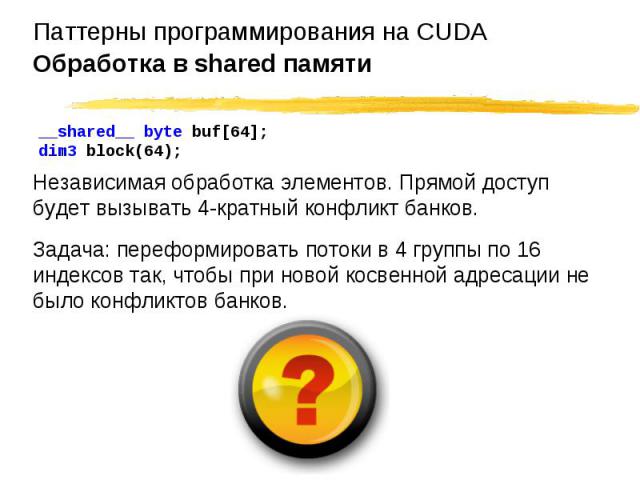

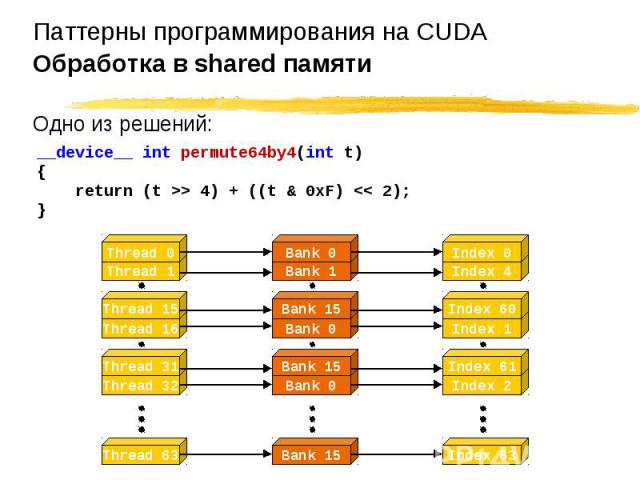

__device__ int permute64by4(int t) __device__ int permute64by4(int t) { return (t >> 4) + ((t & 0xF) << 2); }

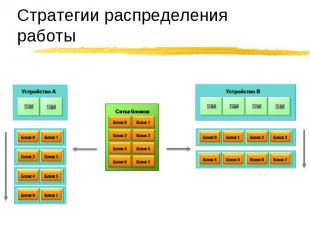

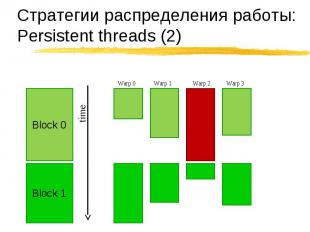

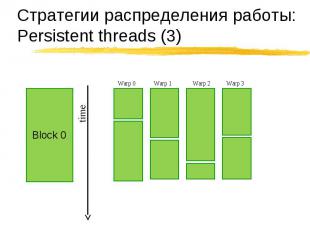

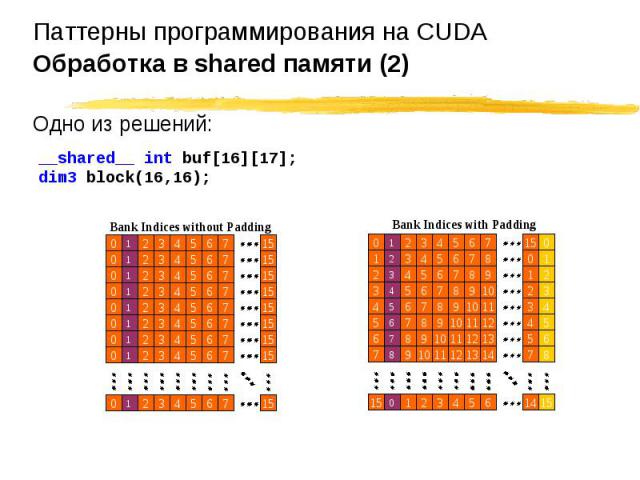

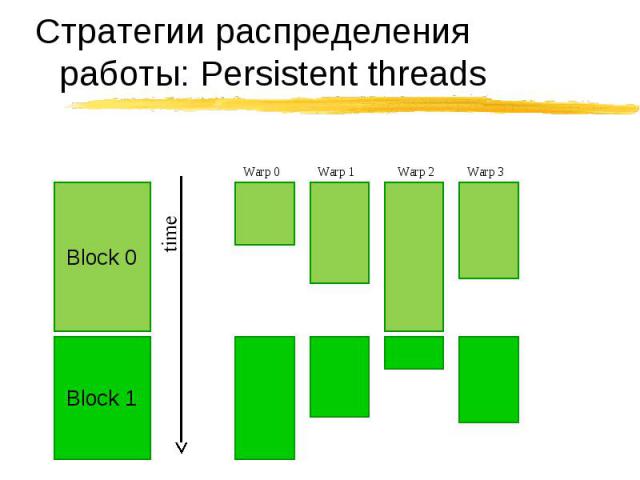

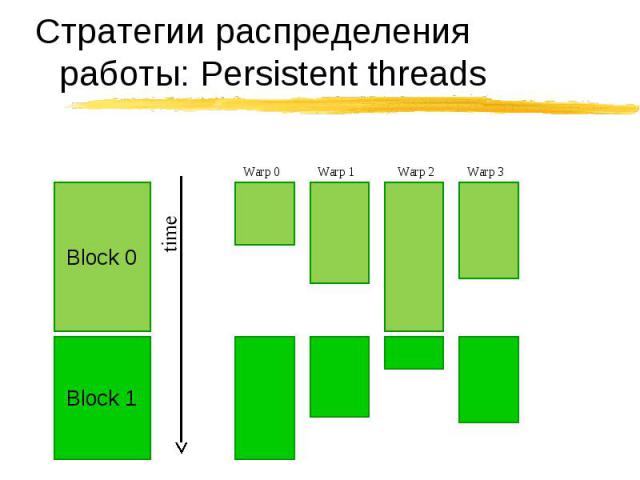

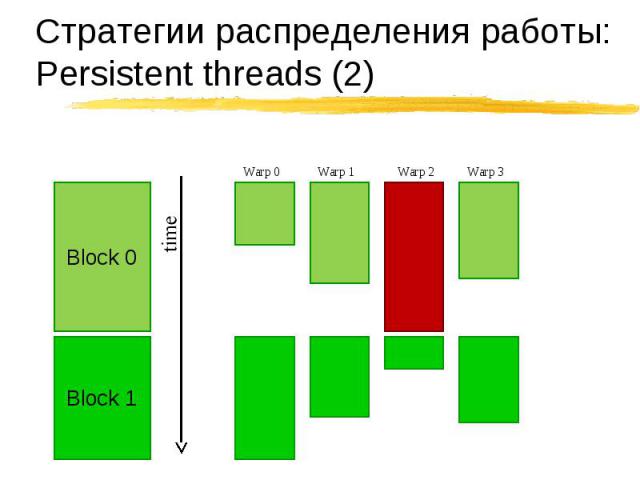

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Стратегии распределения работы Command & Conquer Uber-kernel Persistent threads Разное

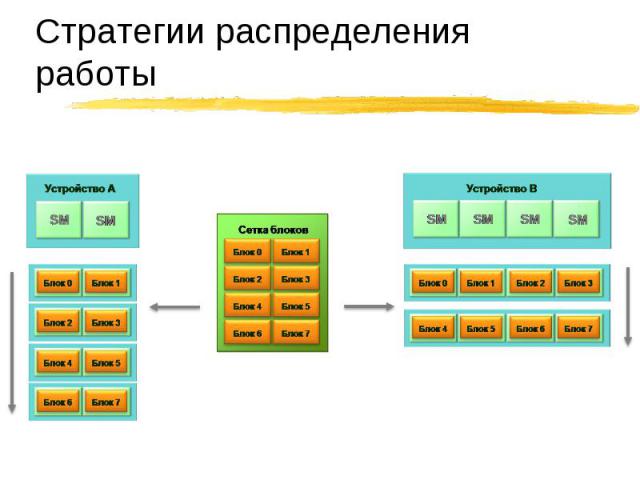

Задачи с нерегулярным параллелизмом Задачи с нерегулярным параллелизмом Переменное кол-во итераций Большое кол-во ветвлений

Разделить ядра на более простые Разделить ядра на более простые Позволяет выявить bottleneck Увеличивает Occupancy Возможность перераспределять работу между ядрами

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Стратегии распределения работы Command & Conquer Uber-kernel Persistent threads Разное

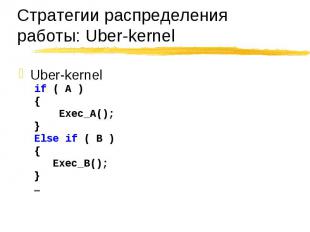

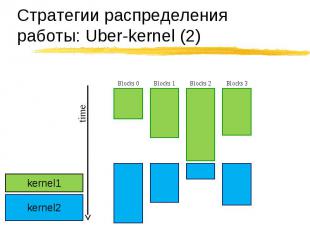

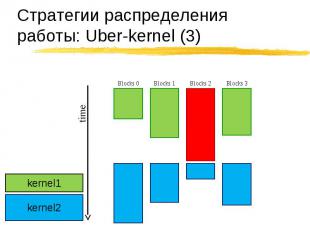

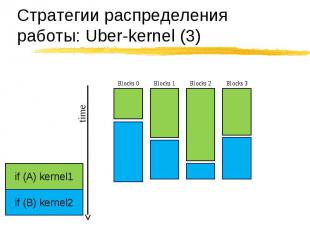

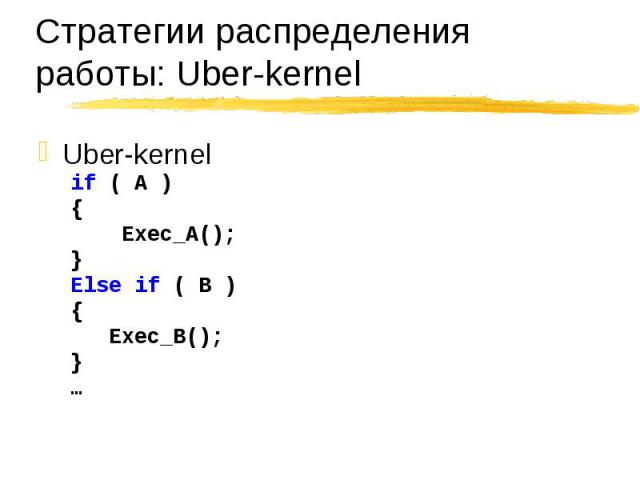

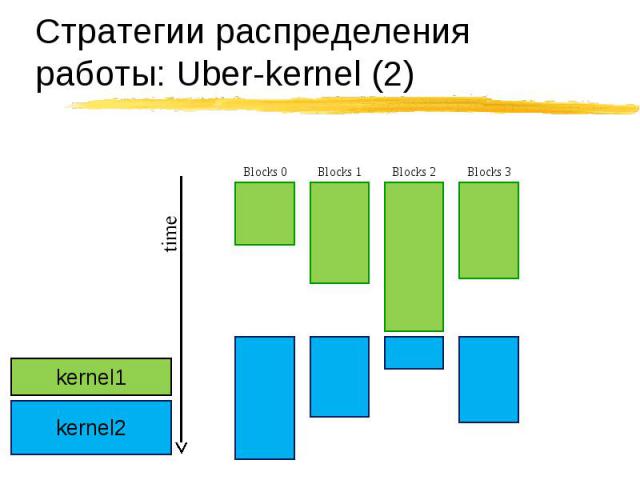

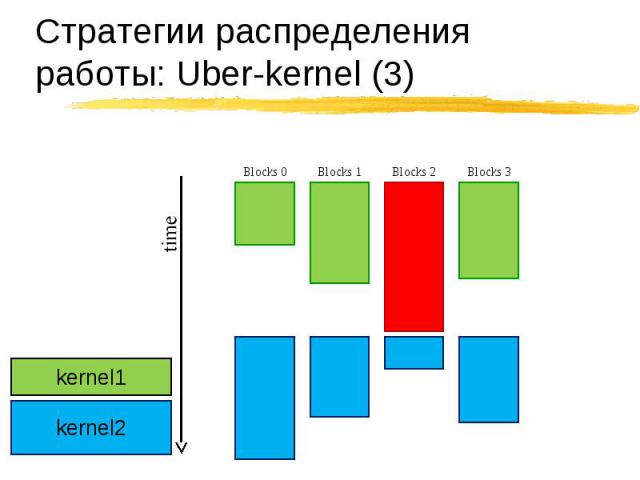

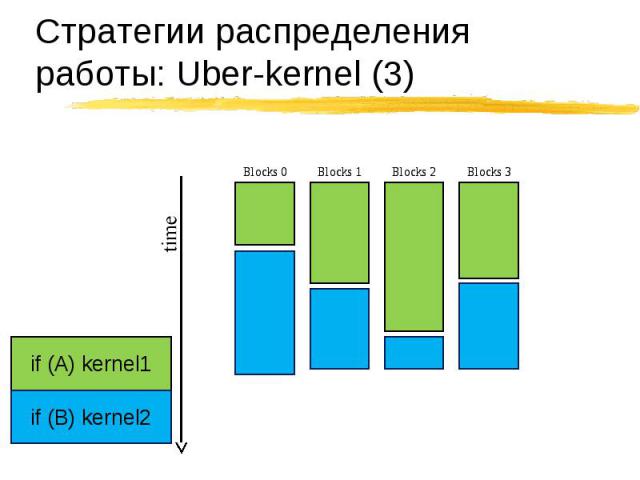

Uber-kernel Uber-kernel

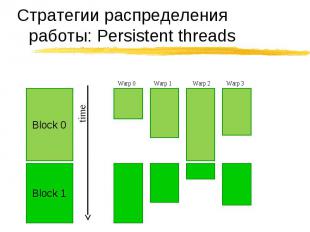

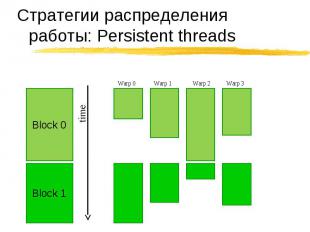

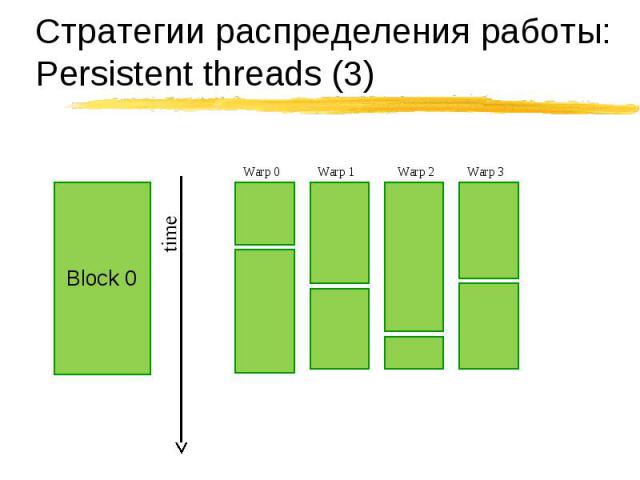

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Стратегии распределения работы Command & Conquer Uber-kernel Persistent threads Разное

Процесс разработки программ CUDA Процесс разработки программ CUDA Работа с различными типами памяти Паттерны программирования на CUDA Стратегии распределения работы Разное

Если происходит ветвление внутри варпа, то разные ветви исполнения сериализуются Если происходит ветвление внутри варпа, то разные ветви исполнения сериализуются Увеличивается общее количество инструкций Если ветвление происходит между варпами, то штраф минимальный

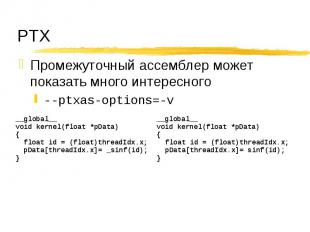

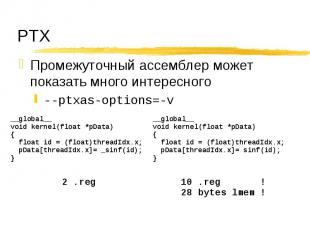

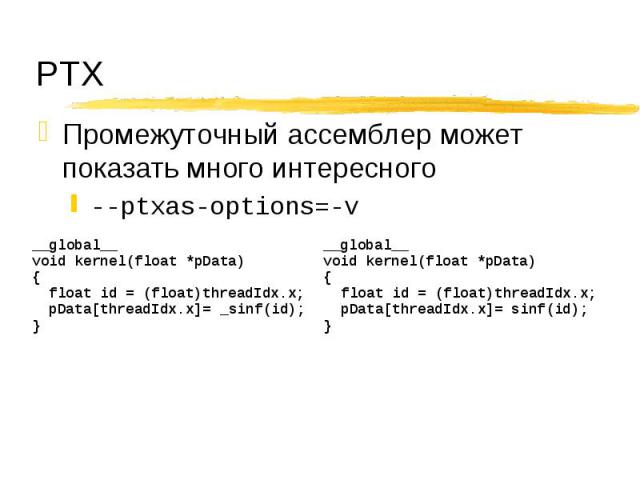

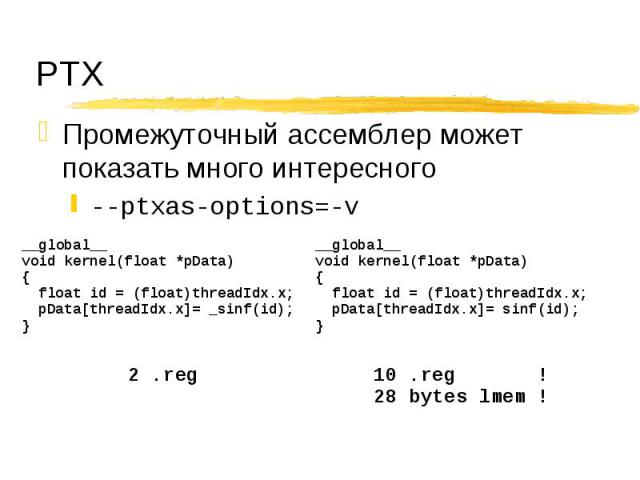

Промежуточный ассемблер может показать много интересного Промежуточный ассемблер может показать много интересного --ptxas-options=-v

Промежуточный ассемблер может показать много интересного Промежуточный ассемблер может показать много интересного --ptxas-options=-v

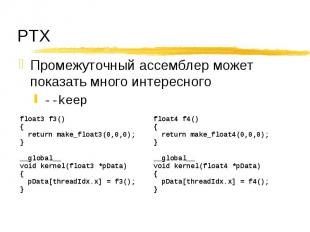

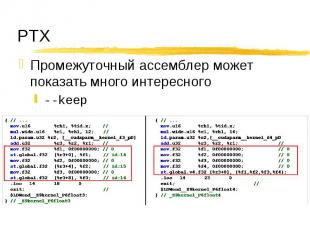

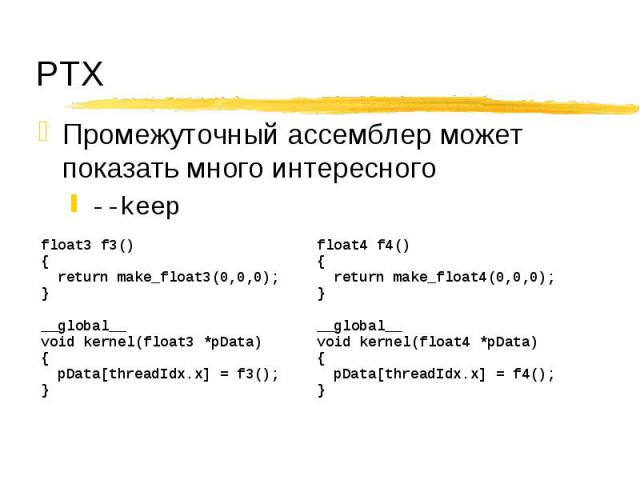

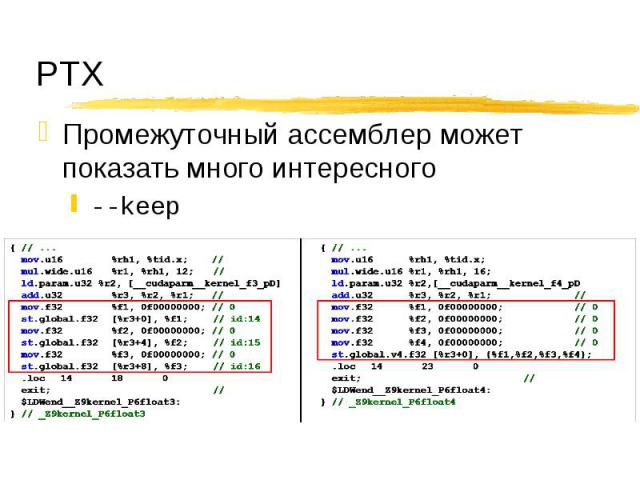

Промежуточный ассемблер может показать много интересного Промежуточный ассемблер может показать много интересного --keep

Промежуточный ассемблер может показать много интересного Промежуточный ассемблер может показать много интересного --keep

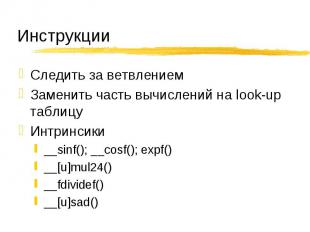

Следить за ветвлением Следить за ветвлением Заменить часть вычислений на look-up таблицу Интринсики __sinf(); __cosf(); expf() __[u]mul24() __fdividef() __[u]sad()

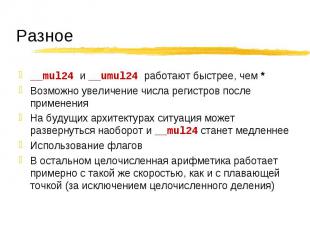

__mul24 и __umul24 работают быстрее, чем * __mul24 и __umul24 работают быстрее, чем * Возможно увеличение числа регистров после применения На будущих архитектурах ситуация может развернуться наоборот и __mul24 станет медленнее Использование флагов В остальном целочисленная арифметика работает примерно с такой же скоростью, как и с плавающей точкой (за исключением целочисленного деления)

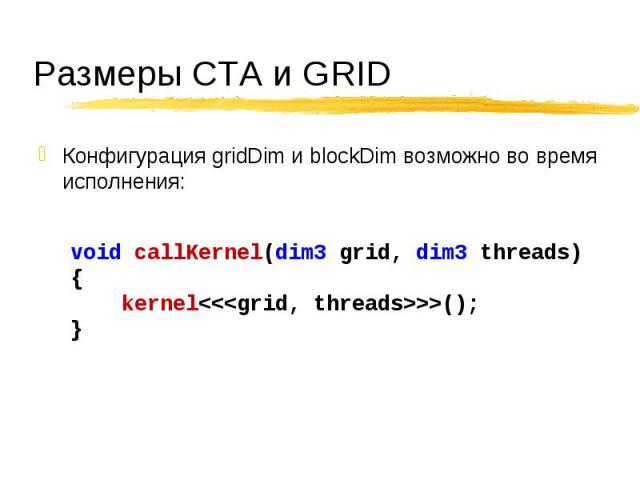

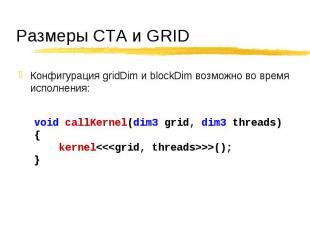

Конфигурация gridDim и blockDim возможно во время исполнения: Конфигурация gridDim и blockDim возможно во время исполнения:

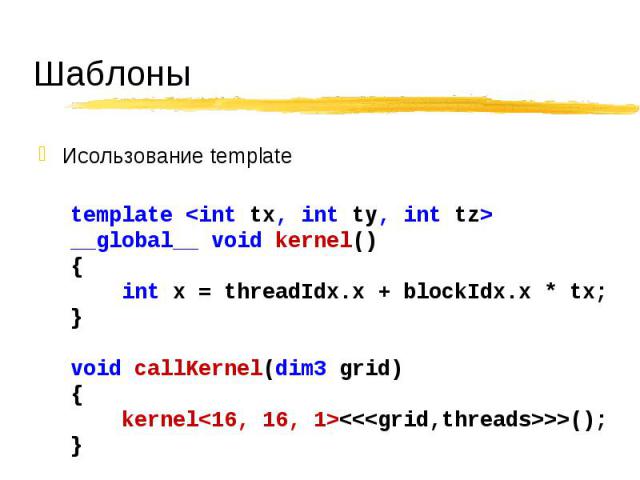

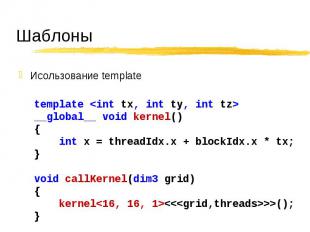

Исользование template Исользование template

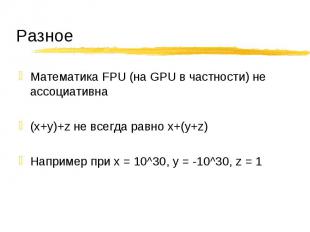

Математика FPU (на GPU в частности) не ассоциативна Математика FPU (на GPU в частности) не ассоциативна (x+y)+z не всегда равно x+(y+z) Например при x = 10^30, y = -10^30, z = 1

CUDA.CS.MSU.SU CUDA.CS.MSU.SU Место для вопросов и дискуссий Место для материалов нашего курса Место для ваших статей! Если вы нашли какой-то интересный подход! Или исследовали производительность разных подходов и знаете, какой из них самый быстрый! Или знаете способы сделать работу с CUDA проще! www.steps3d.narod.ru www.nvidia.ru

Александр Гужва Александр Гужва Антон Обухов Владимир Фролов Дмитрий Ватолин Дмитрий Микушин Евгений Перепелкин Михаил Смирнов Николай Сахарных

![dim3 block(64); dim3 block(64); __shared__ float dst[64]; __global__ void kernel(float *data) {//coalescing, no bank conflicts dst[threadIdx.x] = data[threadIdx.x]; } dim3 block(64); dim3 block(64); __shared__ float dst[64]; __global__ void kernel(float *data) {//coalescing, no bank conflicts dst[threadIdx.x] = data[threadIdx.x]; }](https://fs1.ppt4web.ru/images/95232/150388/640/img43.jpg)

![dim3 block(64); dim3 block(64); __shared__ byte dst[64]; __global__ void kernel_bad(byte *data) {//no coalescing, 4-way bank conflicts present dst[threadIdx.x] = data[threadIdx.x]; } __global__ void kernel_good(byte *data) {//coalescing, no bank con… dim3 block(64); dim3 block(64); __shared__ byte dst[64]; __global__ void kernel_bad(byte *data) {//no coalescing, 4-way bank conflicts present dst[threadIdx.x] = data[threadIdx.x]; } __global__ void kernel_good(byte *data) {//coalescing, no bank con…](https://fs1.ppt4web.ru/images/95232/150388/640/img44.jpg)

![Следить за ветвлением Следить за ветвлением Заменить часть вычислений на look-up таблицу Интринсики __sinf(); __cosf(); expf() __[u]mul24() __fdividef() __[u]sad() Следить за ветвлением Следить за ветвлением Заменить часть вычислений на look-up таблицу Интринсики __sinf(); __cosf(); expf() __[u]mul24() __fdividef() __[u]sad()](https://fs1.ppt4web.ru/images/95232/150388/640/img73.jpg)