Презентация на тему: КоличествоИнформации

Существует 2 подхода при определении количества информации – смысловой и технический (алфавитный). Смысловой применяется для измерения информации, используемой человеком, а технический (или алфавитный) – компьютером. Существует 2 подхода при определении количества информации – смысловой и технический (алфавитный). Смысловой применяется для измерения информации, используемой человеком, а технический (или алфавитный) – компьютером.

Процесс познания окружающего мира приводит к накоплению информации в форме знаний (фактов, научных теорий и т. д.). Процесс познания окружающего мира приводит к накоплению информации в форме знаний (фактов, научных теорий и т. д.). Получение новой информации приводит к расширению знаний или, как иногда говорят, к уменьшению неопределенности знания. Если некоторое сообщение приводит к уменьшению неопределенности нашего знания, то можно говорить, что такое сообщение содержит информацию.

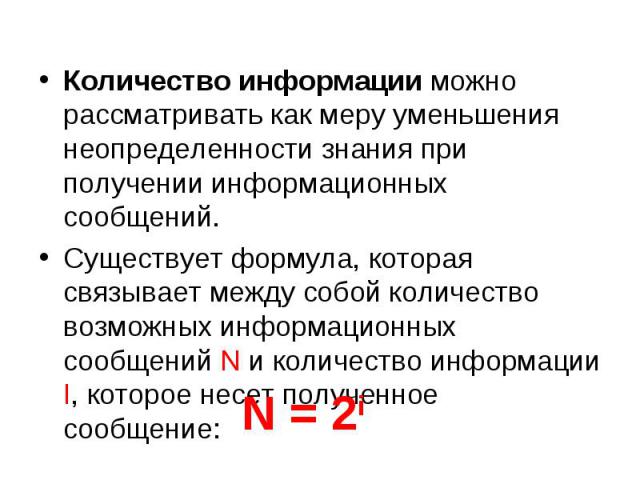

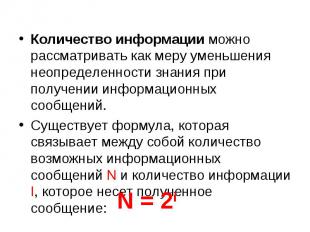

Количество информации можно рассматривать как меру уменьшения неопределенности знания при получении информационных сообщений. Количество информации можно рассматривать как меру уменьшения неопределенности знания при получении информационных сообщений. Существует формула, которая связывает между собой количество возможных информационных сообщений N и количество информации I, которое несет полученное сообщение:

За единицу количества информации принимается такое количество информации, которое содержится в информационном сообщении, уменьшающем неопределенность знания в два раза. Такая единица названа битом. За единицу количества информации принимается такое количество информации, которое содержится в информационном сообщении, уменьшающем неопределенность знания в два раза. Такая единица названа битом.

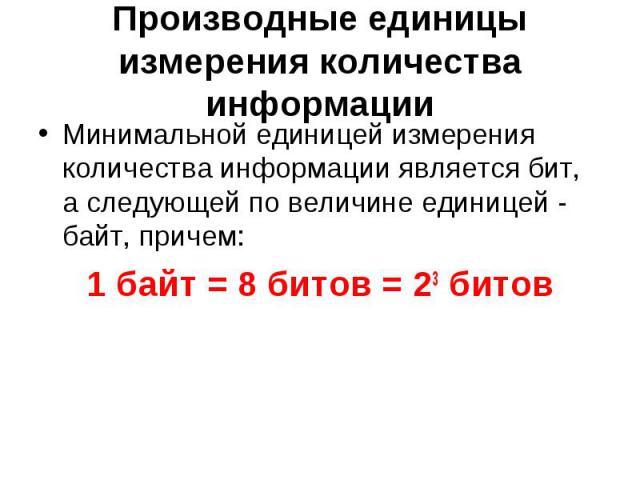

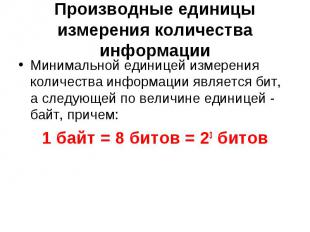

Минимальной единицей измерения количества информации является бит, а следующей по величине единицей - байт, причем: Минимальной единицей измерения количества информации является бит, а следующей по величине единицей - байт, причем: 1 байт = 8 битов = 23 битов

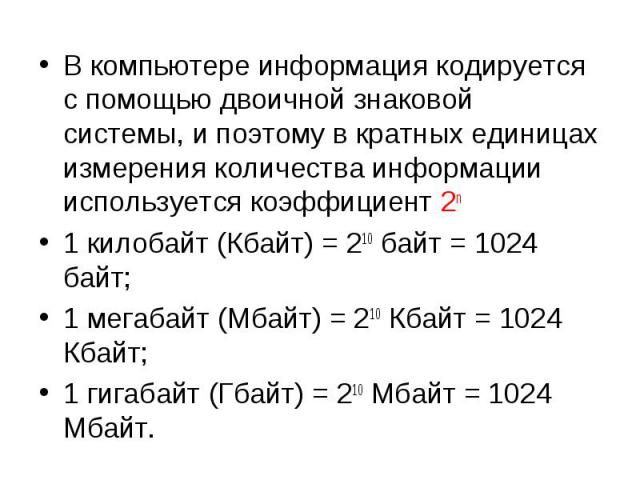

В компьютере информация кодируется с помощью двоичной знаковой системы, и поэтому в кратных единицах измерения количества информации используется коэффициент 2n В компьютере информация кодируется с помощью двоичной знаковой системы, и поэтому в кратных единицах измерения количества информации используется коэффициент 2n 1 килобайт (Кбайт) = 210 байт = 1024 байт; 1 мегабайт (Мбайт) = 210 Кбайт = 1024 Кбайт; 1 гигабайт (Гбайт) = 210 Мбайт = 1024 Мбайт.

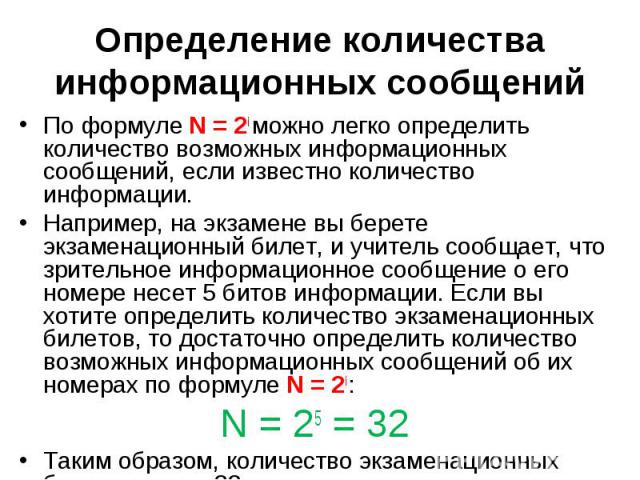

По формуле N = 2i можно легко определить количество возможных информационных сообщений, если известно количество информации. По формуле N = 2i можно легко определить количество возможных информационных сообщений, если известно количество информации. Например, на экзамене вы берете экзаменационный билет, и учитель сообщает, что зрительное информационное сообщение о его номере несет 5 битов информации. Если вы хотите определить количество экзаменационных билетов, то достаточно определить количество возможных информационных сообщений об их номерах по формуле N = 2i : N = 25 = 32 Таким образом, количество экзаменационных билетов равно 32.

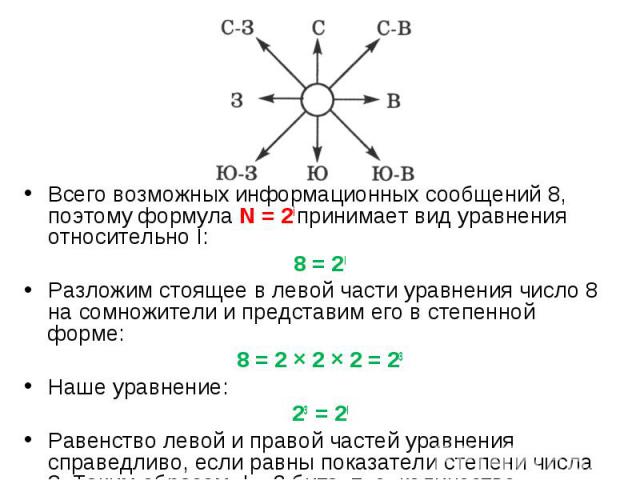

Наоборот, если известно возможное количество информационных сообщений N, то для определения количества информации, которое несет сообщение, необходимо решить уравнение относительно I. Наоборот, если известно возможное количество информационных сообщений N, то для определения количества информации, которое несет сообщение, необходимо решить уравнение относительно I. Представьте себе, что вы управляете движением робота и можете задавать направление его движения с помощью информационных сообщений: "север", "северо-восток", "восток", "юго-восток", "юг", "юго-запад", "запад" и "северо-запад". Какое количество информации будет получать робот после каждого сообщения?

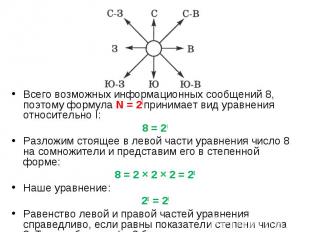

Всего возможных информационных сообщений 8, поэтому формула N = 2i принимает вид уравнения относительно I: Всего возможных информационных сообщений 8, поэтому формула N = 2i принимает вид уравнения относительно I: 8 = 2I Разложим стоящее в левой части уравнения число 8 на сомножители и представим его в степенной форме: 8 = 2 × 2 × 2 = 23 Наше уравнение: 23 = 2I Равенство левой и правой частей уравнения справедливо, если равны показатели степени числа 2. Таким образом, I = 3 бита, т. е. количество информации, которое несет роботу каждое информационное сообщение, равно 3 битам.

При алфавитном подходе к определению количества информации отвлекаются от содержания информации и рассматривают информационное сообщение как последовательность знаков определенной знаковой системы. При алфавитном подходе к определению количества информации отвлекаются от содержания информации и рассматривают информационное сообщение как последовательность знаков определенной знаковой системы.

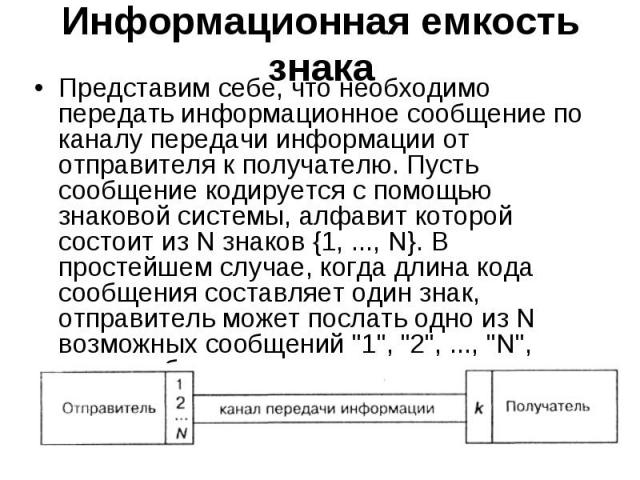

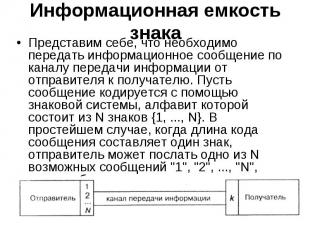

Представим себе, что необходимо передать информационное сообщение по каналу передачи информации от отправителя к получателю. Пусть сообщение кодируется с помощью знаковой системы, алфавит которой состоит из N знаков {1, ..., N}. В простейшем случае, когда длина кода сообщения составляет один знак, отправитель может послать одно из N возможных сообщений "1", "2", ..., "N", которое будет нести количество информации I. Представим себе, что необходимо передать информационное сообщение по каналу передачи информации от отправителя к получателю. Пусть сообщение кодируется с помощью знаковой системы, алфавит которой состоит из N знаков {1, ..., N}. В простейшем случае, когда длина кода сообщения составляет один знак, отправитель может послать одно из N возможных сообщений "1", "2", ..., "N", которое будет нести количество информации I.

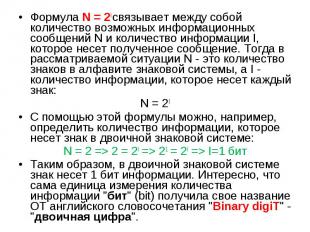

Формула N = 2i связывает между собой количество возможных информационных сообщений N и количество информации I, которое несет полученное сообщение. Тогда в рассматриваемой ситуации N - это количество знаков в алфавите знаковой системы, а I - количество информации, которое несет каждый знак: Формула N = 2i связывает между собой количество возможных информационных сообщений N и количество информации I, которое несет полученное сообщение. Тогда в рассматриваемой ситуации N - это количество знаков в алфавите знаковой системы, а I - количество информации, которое несет каждый знак: N = 2I С помощью этой формулы можно, например, определить количество информации, которое несет знак в двоичной знаковой системе: N = 2 => 2 = 2I => 21 = 2I => I=1 бит Таким образом, в двоичной знаковой системе знак несет 1 бит информации. Интересно, что сама единица измерения количества информации "бит" (bit) получила свое название ОТ английского словосочетания "Binary digiT" - "двоичная цифра".

Информационная емкость знака двоичной знаковой системы составляет 1 бит. Информационная емкость знака двоичной знаковой системы составляет 1 бит.

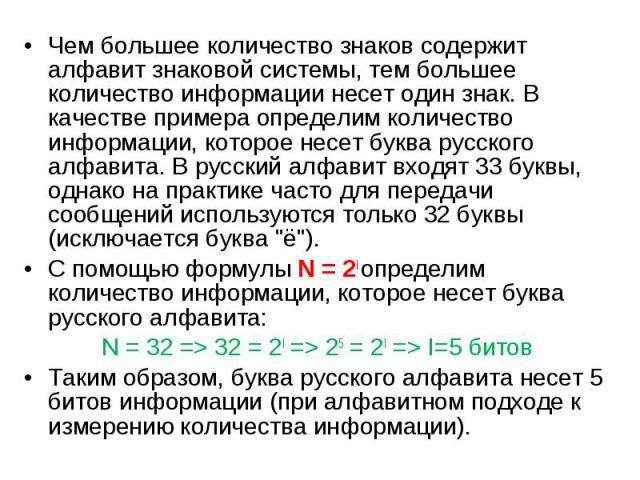

Чем большее количество знаков содержит алфавит знаковой системы, тем большее количество информации несет один знак. В качестве примера определим количество информации, которое несет буква русского алфавита. В русский алфавит входят 33 буквы, однако на практике часто для передачи сообщений используются только 32 буквы (исключается буква "ё"). Чем большее количество знаков содержит алфавит знаковой системы, тем большее количество информации несет один знак. В качестве примера определим количество информации, которое несет буква русского алфавита. В русский алфавит входят 33 буквы, однако на практике часто для передачи сообщений используются только 32 буквы (исключается буква "ё"). С помощью формулы N = 2i определим количество информации, которое несет буква русского алфавита: N = 32 => 32 = 2I => 25 = 2I => I=5 битов Таким образом, буква русского алфавита несет 5 битов информации (при алфавитном подходе к измерению количества информации).

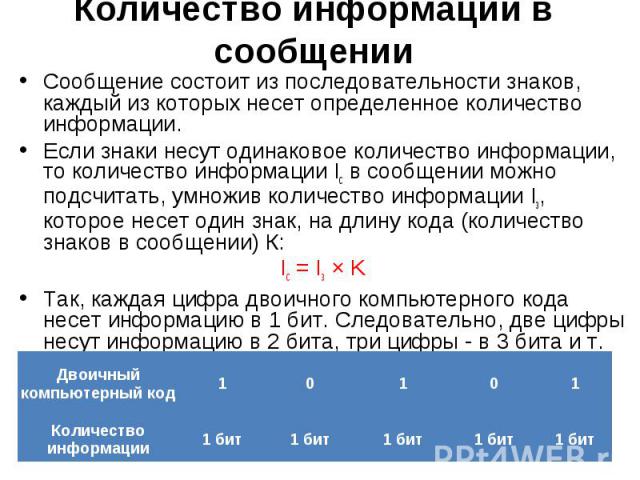

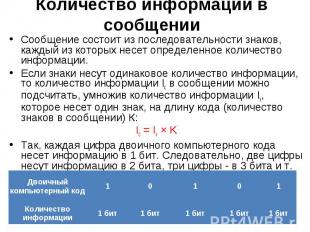

Сообщение состоит из последовательности знаков, каждый из которых несет определенное количество информации. Сообщение состоит из последовательности знаков, каждый из которых несет определенное количество информации. Если знаки несут одинаковое количество информации, то количество информации Ic в сообщении можно подсчитать, умножив количество информации Iз, которое несет один знак, на длину кода (количество знаков в сообщении) К: Ic = Iз × K Так, каждая цифра двоичного компьютерного кода несет информацию в 1 бит. Следовательно, две цифры несут информацию в 2 бита, три цифры - в 3 бита и т. д. Количество информации в битах равно количеству цифр двоичного компьютерного кода

1. Приведите примеры информационных сообщений, которые приводят к уменьшению неопределенности знания. 1. Приведите примеры информационных сообщений, которые приводят к уменьшению неопределенности знания. 2. Приведите примеры информационных сообщений, которые несут 1 бит информации.